回收H5VR64ESA8H-N0CM4SS海力士-回收

- 面议

- 2024-12-20 12:22:59

- 工厂库存,电子料,芯片,GPU显卡HBM

- 北京

- 谢生 13636336610

- 上海睿劳电子科技有限公司

信息介绍

详细参数

回收H5VR64ESA8H-N0CM4SS海力士-回收

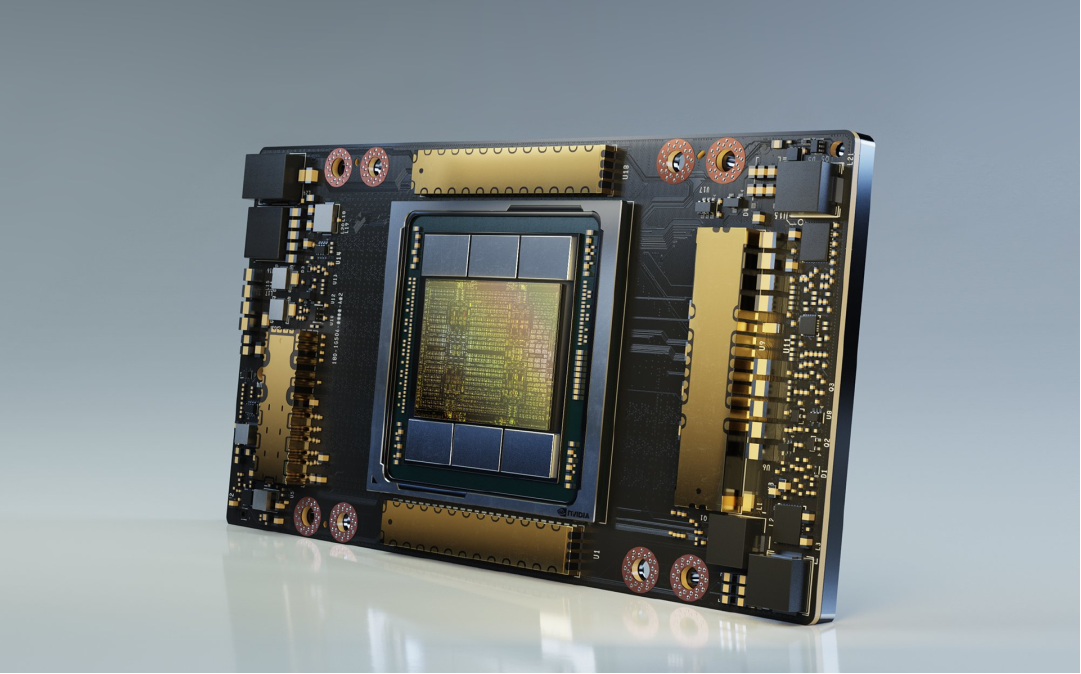

英伟达推出H200的GPU显卡。与代H100相比,H200的性能直接提升了60%到90%。相较于H100,此次的更新在于H200搭载了更快、更大的HBM3e的存储。H200的容量接近翻倍,带宽增加2.4倍,加速生成式AI和大语言模型的同时,推进HPC工作负载的科学计算。H200 在700亿参数的Llama2大模型上的推理速度比H100快了一倍,而且在推理能耗上H200相比H100直接降低了一半。目前,H200预计于2024年第二季度出货。大模型的参数新高。H200的提前发布再次证明持续奔跑这种能力本身才是英伟达的护城河。在黄氏定律时代,GPU将推动AI性能实现逐年翻倍,GPU的进化速度可能远超投资者的预期。

当H100横空出世时,这几乎成为大模型时代的资源。但是市场终究不会只让英伟达自享受新时代的算力红利。随即,二号玩家AMD的MI300显卡推出,芯粒堆叠技术使得晶体管的数量达到疯狂的1460亿个。同时,这款显卡芯片集成了Zen4架构的24个CPU核心、大容量的Infinity Cache无限缓存,还有8192-bit位宽、128GB容量的HBM3高带宽内存。Intel、IBM等科技以及新晋企业正陆续推出新的AI芯片,试图与英伟达AI芯片抗衡;谷歌、微软、、阿里、百度等公司也纷纷布局自研芯片,以减少对外部供应商的依赖。所以,在芯片行业内,一款产品很难形成一个超过两年的护城河。此次更大内存,更大带宽的H200发布再次证明英伟达持续奔跑,持续的能力或是英伟达真正的护城河。看好AI进入快速发展的成长期,能见度持续至2024年。

1.)算力是一切变革的基础设施。此次H200的发布,将过去数据中心芯片两年一更新的速率直接翻倍。

2.)更强劲,更的大模型GPT 4 Turbo发布降低进入门槛,自定义GPT+GPT应用商店预计将打造一个充满活力的软件与应用生态。

3.)性能无边的B100与GPT5预计在2024年发布,重磅升级或释放的生产力。

回收英伟达GPU显卡芯片/服务器/AI智能大模块/单卡/拆机型号:

型号AA---------A100-A800-H100-H800-SXM4-SXM5

GA100-893FF-A1 GA100-895GG1-A1 GA100-895FF-A1 GA100-875GG1-A1 GA100-874AA-A1 GA100-884AA-A1 GA100-882AA-A1 GH100-884K-A1 GH100-885F-A1 H800-865K-A1

GA102-895-A1 GA102-875-A1 GA102-850-A1 GA104-875-A1 TU102-875-A1 AD102-30B-A1 AD102-87S-A1 AD102-895-A1 AD104-895-A1 AD103-301-A1 AD104-875-A1

GA100-893FF-A1 GA100-895GG1-A1 GA100-895FF-A1 GA100-875GG1-A1 GA100-874 AA-A1 GA100-884 AA-A1 GA100-882AA-A1 GH100-884K-A1 GH100-885F-A1 H800865K-A1

GA102-895-A1 GA10-87-A1 GA102-85-A1 GA104-875-A1 TU102-875-A1 AD102-30-A1 AD102-87-A1AD102-895-A1AD104-895-A1 AD103-301-A1 AD104-875-A1TU104-450-A1 TU106-410-A1

TU1040-A1 TU102-300A-K1-A1 TU102-30AKS-A1 T7U104-400A-A1 TU104-40O-A1 TU106-20A-KA-A1 TU106-400A-A1 TU106-400A-A1 GP102-3004-K1-A1 TU102-300A4K5-A TU116-4-A1 TU116-310-A1

GP106-350-K1-A1 GV102-400-A1 GP104-30-A1 GP104-2-A1 GP104-40-A1 GP106-400-A1 GP106-30-A1GP107-400-A1

- 工厂库存,电子料,芯片,GPU显卡HBM

- 记忆存储芯片

- 北京

- 谢生